ゴジラ・ナイト解説

Mixed Reality ゴーグル「HoloLens」を装着して、日比谷に現れたゴジラを巨大不明生物災害対策本部(巨災対)直轄の精鋭迎撃部隊メンバーとなって迎撃するイベント「ゴジラ・ナイト」が日比谷シャンテ前ゴジラスクエアで開催されています。(5/24~29)

ここでは、その詳細を説明します。

ダイジェスト版をPDFでダウンロ―ド → ゴジラ・ナイト解説.pdf

世界初の ホログラフィック コンピューター HoloLens

今回使用しているデバイスが、Microsoftが開発した世界初のホログラフィックコンピューターデバイス 「HoloLens」です。HoloLensにはシースルー型のスクリーンが搭載されていて、目の前の空間に高精細なホログラフィックを表示することができます。

このグラフィックはただ、映像として現れているのではなく、目の前の空間の指定した座標上に3Dのホログラフィックとして表示されます。さらに HoloLens は「壁がある」「机の表面」のように周りに何か物理的なものがあるか認識する機能を持っていて、認識したものとホログラフィック干渉を制御する機能もあります。

ちょっと難しいかもしれませんが、要はあたかもそこに物理的な物があるかのように、3Dデータ表示することが出来て、床にぶつかって止まる、隠れて見えないとう体験を再現することができます。

[video width="484" height="272" mp4="https://msdnshared.blob.core.windows.net/media/2018/05/MR.mp4"][/video]

参考:世界初のホログラフィックコンピューター Microsoft HoloLens

ゴジラ迎撃作戦

このイベントでは、参加ユーザーは巨災対のメンバーとなって、日比谷に現れたゴジラ迎撃の任務を遂行します。初めに日比谷シャンテ前ゴジラスクエアに作られた仮設テント内で、作戦についてのブリーフィングを行います。

HoloLens はパーソナルデバイスです。HoloLens での映像は装着者本人にしか見ることができないため、このように周りに人がいる環境であっても、秘匿性の高いデータを安全に見ることができ、情報漏洩を防ぐことができます。

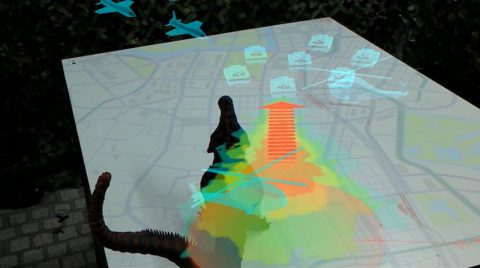

参加者は夏目司令官の元、現在のゴジラの進行状況をホログラフィックで確認し、現状の迎撃態勢についても全体図を共有します。ここでは地図とゴジラは実際に用意されたものですが、そこに映し出される進行ルートや迎撃用の戦車、航空機は全てHoloLens内で表示されます。

実は HoloLens には Windows 10 が内蔵されています。そして、この作戦情報もアプリとして提供されています。しかし、ここにはマウスもタッチパネルもありません。ではどうやって操作するのか?

実は、HoloLens は手に持って操作するマウスやコントローラーを必要としません。HoloLens の操作は指でつまんだり動かしたりする「ジェスチャー」を使って行います。ジェスチャーを使ってアプリを操作することで様々な情報を表示することがでできます。

ゴジラの接近

作戦確認を終え、ゴジラの接近を確認した夏目司令官はいよいよ迎撃作戦を実行します。参加した隊員は精鋭部隊としてミサイルによる迎撃任務を任されます。隊員は迎撃ステージに移動し迎撃用 HoloLens を装着。ようやく準備ができるや否や、その眼前には 118.5mの巨大なゴジラが現れます。

[video width="484" height="272" mp4="https://msdnshared.blob.core.windows.net/media/2018/05/GodzillaNightStageMovieS.mp4"][/video]

HoloLens のスクリーン映るこのゴジラは平面からの映像ではありません。完全な3Dモデルとなったゴジラが現れます。そして、このゴジラはアプリ内の空間上では迎撃ステージ前方の日比谷公園のあたりに出現しています。

ですから、もし隊員がステージを降りて前の方にある行けばより下からゴジラの巨体を見ることができますし、日比谷公園から見たら後ろから迎撃することが出来るでしょう。まさに日比谷にゴジラが石器新下状況そのものを再現しています。これが 現実とホログラフィックが融合した Mixed Reality の世界です。

Microsoft Azure の AI機能との連携

HoloLens は非常に優れたコンピューターですが、それでもモバイルデバイスであるため機能として足りない部分もたくさんあります。そこで足りない機能を支援するために登場するのが、クラウドのコンピューティングパワーを使ったAIによる支援です。

このゴジラ ナイトでのゴジラ迎撃作戦では Microsoft Azure が持つ2つのAI機能を使っています。一つは、作戦確認中の決戦兵器「Rupture」を表示する際に使用する手書き文字認識の機能、もう一つがゴジラ迎撃作戦時の日本語音声コマンドを使うための音声認識の機能です。

作戦確認中の文字認識

作戦の中では戦車、支援戦闘機、攻撃ヘリコプターなど様々な装備が使われますが、それ以外にも数多くの装備が用意されています。状況に応じて夏目司令は使用する装備を選択します。

ではその装備をどうやって表示させるのか。一つは音声コマンドで呼び出す方法が考えられます。しかし作戦を夏目司令が説明している間に、その横で山田隊長が音声コマンドを入力(発声)するのは作戦遂行上、あまり適切な方法とは言えません。

そこで、山田隊長が選択したのが文字認識による入力です。山田隊長が対ゴジラ用のミサイル Rupture の文字を手書きし、HoloLens の作戦司令アプリで読み込むことにより、そのデータはクラウド上で認識され、最終的にRuptyure のミサイルデータがホログラフィックとして表示されます。

文字認識は文字だけでなくその情報がおかれた場所も取得することができるため、ホログラフィック表示と併せての利用に適した方法です。

参考:手書き認識 Microsoft Azure Cognitive Service Computer Vision

【その2】迎撃作戦中の音声認識

作戦確認を終え、ゴジラの接近を確認した夏目司令官はいよいよ迎撃作戦を実行します。参加した隊員は精鋭部隊としてミサイルによる迎撃任務を任されます。その任務とはミサイル発射による直接攻撃の支持。

迎撃ステージに移動しその眼前にゴジラが現れると作戦用 HoloLens には<音声認識中> のサインが現れます。このサインと同時に隊員は「ミサイル発射」の音声コマンドを叫び、迎撃を開始します。

ここで使用したのが2つ目のAI、音声認識です。進行する作戦の中、音声によるコマンド入力は非常に効果的で、かつ柔軟な方法です。

隊員が叫ぶ「みさいるはっしゃ」の音声情報は即座にネットワークを介してクラウドに転送され、そこで日本語による言語として解析されます。音声情報が「ミサイル発射」のコマンドとして認定されると、その結果は迎撃システムに送信され、ミサイルによる迎撃が実行されます。

私たちが普段からスマートフォンで使っているクラウドを使った音声認識は、高い認識精度と、同時に数多くの言語に対応します。こういった機能はスマートフォンでの検索機能だけでなく、こういった専用のアプリの中からでも利用することができます。

参考:音声認識 Microsoft Azure Cognitive Service Speech to Text

MRとAIと私たちのこれから

このイベントにおいて、残念ながら?ゴジラの接近はフィクションです。

しかしここで使われている Mixed Reality デバイス HoloLens や、手書き認識機能、音声認識機能はすべて本物で、様々なアプリやシステムの中で使われてています。

- 世界初のホログラフィックコンピューター Microsoft HoloLens

- 手書き認識 Microsoft Azure Cognitive Service Computer Vision

- 音声認識 Microsoft Azure Cognitive Service Speech to Text

HoloLens が普及してきたら、もっと小型になったら、私たちはお互いの情報を画面ではなく目の前の空間に情報を表示して共有することになるでしょう。たぶんスマートフォンではなく自分の情報は目の前の空間に表示することになります。そこには画面の大きさの制約もありません。そこにいない人たちとも情報を共有することだってできます。その操作はジェスチャーや音声コマンドになっていることでしょう。

こんな話は少し前だったら、映画の中の世界だけのお話でした。しかしこのイベントを体験した方々がこれが単なる空想の話ではなく、既に実現できることに気が付いたはずです。

勿論私たちの生活がここまで変わるにはもう少し時間がかかるでしょう。しかし技術の進歩は恐るべき速さで進化を続けています。ほんの一部の人しか持っていなかったスマートフォンは5年でだれもが持っているデバイスとなりました。たぶん5年後に私たちが手にしているデバイスは大きく様変わりしているはずです。

現実とコンピューティングパワーが融合した Mixed Reality と、あらゆる方面で進化するAI技術をこのイベントを通じて体感していただけたら嬉しいですね。